Kafka文件存储机制、分区策略与数据可靠性保证

Apache Kafka是一个高吞吐量、分布式的消息系统,广泛应用在实时数据处理和存储服务中。其核心设计包括文件存储机制、分区策略与数据可靠性保证,这些机制共同支撑了Kafka的高性能和容错能力。

一、Kafka文件存储机制

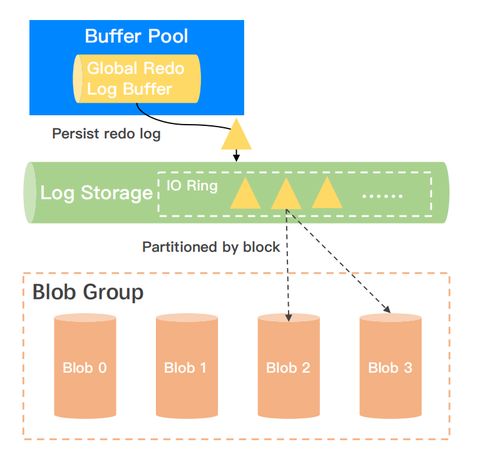

Kafka的文件存储机制基于日志结构的设计,将所有消息持久化到磁盘上的日志文件中。关键点包括:

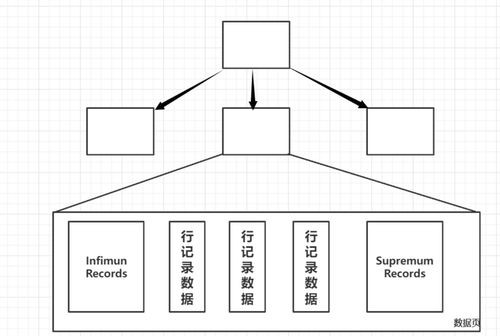

- 分段存储:每个主题分区被划分为多个日志段(segment),每个段包括.index和.log文件。.log文件存储实际消息,而.index文件存储消息的偏移量索引,便于快速检索。

- 顺序写入:Kafka采用追加写入(append-only)的方式,消息按顺序写入当前活跃的日志段,这大大提高了磁盘I/O效率,避免了随机写入的性能瓶颈。

- 数据保留与清理:Kafka支持基于时间或大小的数据保留策略,例如设置消息在磁盘上保留7天或1GB大小。当数据超出限制时,可以自动删除旧日志段或压缩日志以减少存储空间。

这种存储机制确保了高吞吐量,因为顺序写入和索引优化减少了磁盘寻址时间,同时分段设计便于管理和扩展。

二、分区策略

分区是Kafka实现并行处理和负载均衡的核心。分区策略决定了消息如何分配到不同分区:

- 轮询分区:默认策略,消息均匀分布到所有分区,确保负载均衡。适用于无特定顺序要求的场景。

- 键分区:如果消息指定了键(key),Kafka使用哈希函数将相同键的消息分配到同一分区,保证同一键的消息顺序性。这对于需要局部有序的数据(如用户行为日志)至关重要。

- 自定义分区:用户可以实现Partitioner接口,根据业务逻辑自定义分区规则,例如基于地理位置或用户ID分区。

分区的优势在于:提高并行处理能力,允许消费者组中的多个消费者同时消费不同分区,从而提升整体吞吐量。分区还支持水平扩展,当数据量增加时,可以通过增加分区来分散负载。

三、数据可靠性保证

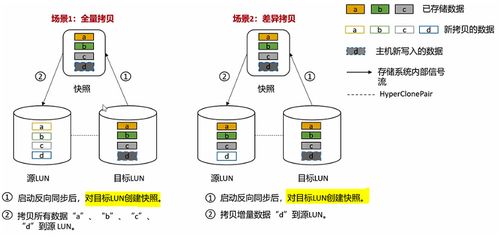

Kafka通过多副本机制和确认机制确保数据的高可靠性:

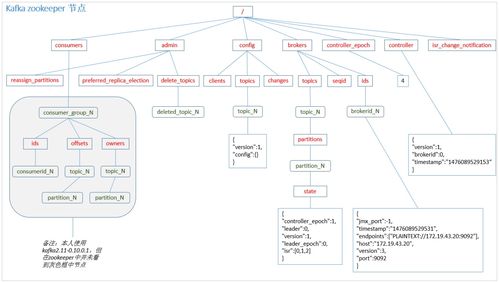

- 副本机制:每个分区可以有多个副本(replicas),包括一个领导者(leader)和多个追随者(follower)。领导者处理所有读写请求,追随者从领导者复制数据。如果领导者故障,Kafka会自动从追随者中选举新的领导者,实现故障转移。

- ISR集合:Kafka维护一个“同步副本”集合(In-Sync Replicas, ISR),包含与领导者数据同步的副本。只有在ISR中的副本才参与领导者选举,这防止了数据丢失。

- 生产者确认:生产者可以设置acks参数来控制可靠性级别:

- acks=0:不等待确认,可能丢失数据。

- acks=1:等待领导者确认,数据可能丢失(如果领导者故障)。

- acks=all:等待所有ISR副本确认,确保数据持久化,提供最高可靠性。

- 数据持久化:消息一旦被确认,就会持久化到磁盘。结合副本机制,即使部分节点故障,数据也不会丢失。

这些机制使Kafka在分布式环境中能够处理高并发数据流,同时保证数据的完整性和可用性,适用于金融、日志聚合等对可靠性要求高的场景。

四、在数据处理和存储服务中的应用

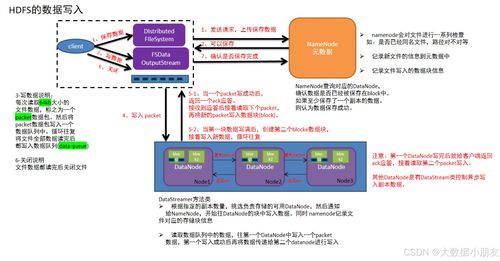

在数据处理和存储服务中,Kafka的存储机制、分区策略和可靠性保证共同支持实时数据管道:

- 数据集成:Kafka可以作为数据源,将来自多个应用的数据聚合到中央存储(如数据湖或数据库),分区策略确保数据均匀分布。

- 流处理:与流处理框架(如Apache Flink或Spark Streaming)集成,Kafka的分区允许并行处理,提高实时分析效率。

- 容错存储:通过副本和确认机制,Kafka在分布式系统中提供可靠的中间存储层,防止数据丢失,支持系统的高可用性。

Kafka的文件存储机制、分区策略和数据可靠性保证使其成为现代数据处理架构的基石,能够高效、可靠地处理大规模实时数据流。

如若转载,请注明出处:http://www.jisudianzimiandan.com/product/25.html

更新时间:2025-11-28 13:10:14